研究揭示了在对话中使用人工智能的社会成本

康奈尔大学的一组研究人员发现,当使用支持人工智能的聊天工具时,人们有更有效的对话,使用更积极的语言,更积极地看待彼此。

博士后研究员Jess Hohenstein是发表在《科学报告》上的“沟通中的人工智能影响语言和社会关系”的主要作者。

合著者包括康奈尔安·S·鲍尔斯计算与信息科学学院(Cornell Bowers CIS)信息科学副教授Malte Jung和信息科学助理教授Rene Kizilcec(Cornell Bowers CIS)。

生成式人工智能有望影响社会、沟通和工作的方方面面。每天都有新的证据证明像ChatGPT和GPT-4这样的大型语言模型(LLM)的技术能力,但将这些技术集成到我们日常生活中的社会后果仍然知之甚少。

人工智能工具具有提高效率的潜力,但它们可能会产生负面的社会副作用。海恩斯坦及其同事研究了在对话中使用人工智能如何影响人们表达自己和看待彼此的方式。

“科技公司倾向于强调人工智能工具的效用,以更快更好地完成任务,但他们忽视了社会层面,”荣格说。“我们不是孤立地生活和工作,我们使用的系统会影响我们与他人的互动。

除了更高的效率和积极性之外,该小组还发现,当参与者认为他们的伴侣正在使用更多人工智能建议的回应时,他们认为该伴侣不太合作,并且对他们的归属感也更少。

“我很惊讶地发现,人们倾向于对你更负面的评价,因为他们怀疑你在用人工智能来帮助你撰写文本,不管你是否真的是,”海恩斯坦说。“这说明了人们对人工智能的持续怀疑。

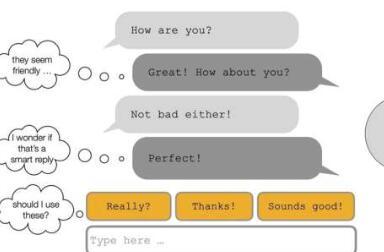

对于他们的第一次实验,共同作者Dominic DiFranzo,康奈尔机器人和团体实验室的前博士后研究员,现在是利哈伊大学的助理教授,开发了一个智能回复平台,名为“Moshi”(日语为“hello”),以现已解散的谷歌“Allo”(法语为“hello”)为模式,这是第一个智能回复平台,于2016年推出。智能回复由LLM生成,以预测基于聊天的交互中合理的下一个响应。

共有219对参与者被要求谈论一个政策问题,并被分配到三个条件之一:两个参与者都可以使用智能回复;只有一个参与者可以使用智能回复;或者,参与者都无法使用智能回复。

研究人员发现,使用智能回复可以提高沟通效率、积极的情感语言和沟通伙伴的积极评价。平均而言,智能回复占已发送消息的14.3%(七分之一)。

但是,他们的伴侣怀疑用智能回复回应的参与者比那些被认为输入自己回复的参与者更负面,这与关于人工智能负面影响的常见假设一致。

在第二个实验中,299对随机分配的参与者被要求在以下四种情况之一下讨论政策问题:没有聪明的回答;默认的谷歌智能回复;聪明地以积极的情绪语气回答;以及带有负面情绪基调的人。正面回复和谷歌智能回复的存在导致对话比消极或没有智能回复的对话具有更积极的情绪基调,突出了人工智能对日常对话中语言产生的影响。

“虽然人工智能可能能够帮助你写作,”海恩斯坦说,“但它正在以你意想不到的方式改变你的语言,特别是让你听起来更积极。这表明,通过使用文本生成人工智能,你正在牺牲自己的一些个人声音。

荣格说:“我们在这项研究中观察到的是人工智能对社会动态的影响,以及将人工智能整合到社会环境中可能导致的一些意想不到的后果。这表明,控制算法的人可能会影响人们的互动、语言和对彼此的看法。

免责声明:本文由用户上传,与本网站立场无关。财经信息仅供读者参考,并不构成投资建议。投资者据此操作,风险自担。 如有侵权请联系删除!

-

【禁不住念什么】在日常生活中,我们常常会遇到一些词语让人“禁不住”去读、去想,甚至去写。其中,“禁不住...浏览全文>>

-

【禁闭岛结局】《禁闭岛》(英文名:Shutter Island)是一部由马丁·斯科塞斯执导,莱昂纳多·迪卡普里奥主演...浏览全文>>

-

【禁闭岛的结局真相】《禁闭岛》(英文名:Shutter Island)是一部由马丁·斯科塞斯执导,莱昂纳多·迪卡普里...浏览全文>>

-

【靳字怎么读】在日常生活中,我们经常会遇到一些不常见的汉字,这些字不仅发音复杂,含义也常常让人感到困惑...浏览全文>>

-

【靳这个字怎么念】“靳”是一个较为少见的汉字,常用于人名或姓氏中。对于不熟悉该字的人来说,可能会不知道...浏览全文>>

-

【靳怎么读音】“靳”是一个较为少见的汉字,常出现在人名或地名中。对于不熟悉这个字的人来说,可能会对其读...浏览全文>>

-

【靳东个人资料】靳东是中国内地著名的男演员,因在多部影视作品中表现出色而广受观众喜爱。他以沉稳的气质、...浏览全文>>

-

【靳东的妹妹为什么叫高露】很多人对“靳东的妹妹为什么叫高露”这一问题感到疑惑,因为从名字上看,似乎“高...浏览全文>>

-

【金枝玉叶剧情简介】《金枝玉叶》是一部以民国时期为背景的都市情感剧,讲述了出身名门的女主角在家族、爱情...浏览全文>>

-

【金枝玉叶花语是什么】“金枝玉叶”是一种常见的观赏植物,因其叶片厚实、色泽翠绿、形态美观而广受喜爱。在...浏览全文>>